基于单个全景相机的视觉里程计

描述

摘要

本文提出了一种新的直接视觉里程计算法,利用360度相机实现鲁棒的定位和建图。本系统使用球面相机模型来处理无需校正的等距柱状图像,扩展稀疏直接法视觉里程计(DSO,direct sparse odometry),从而实现全方位感知。将建图和优化算法应用用于新模型后,可以在局部窗口中对含内、外参在内的相机参数以及三维建图进行联合优化。此外,我们在真实世界和大规模模拟场景中对所提出的算法进行了定性和定量的评估。大量实验表明,我们的系统达到了SOTA的结果。

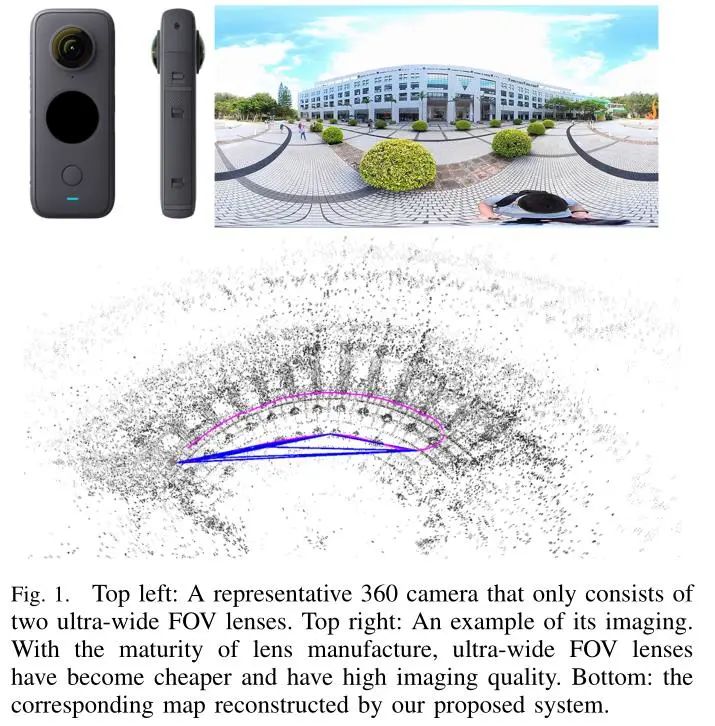

图1 左上方图中是仅由两个超宽视场镜头组成的典型全景相机。右上角是该360相机成像的例图。随着透镜制造行业的成熟,超宽视野透镜变得更便宜,成像质量也更高。下方的图是由本文中360VO系统重建的地图。

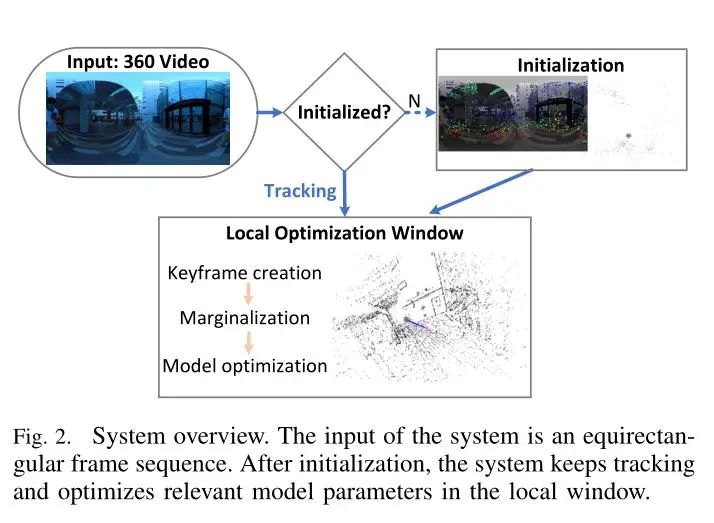

图2 360VO系统概览。该系统的输入是一串等距柱状的帧序列。初始化后,系统在局部窗口中跟踪并优化相关模型参数。

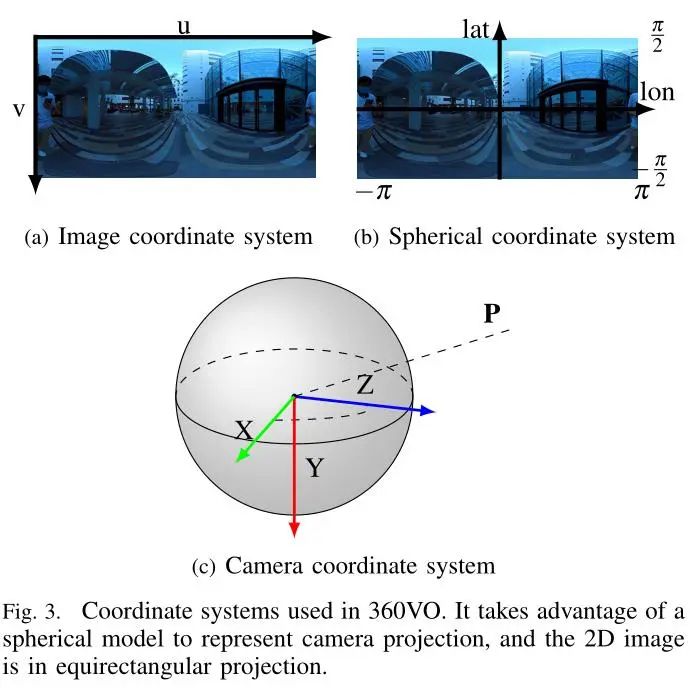

图3 上图显示的是360VO的坐标系,它利用了球面模型的优点来表示相机投影。此外,2D图像是等距柱状投影。

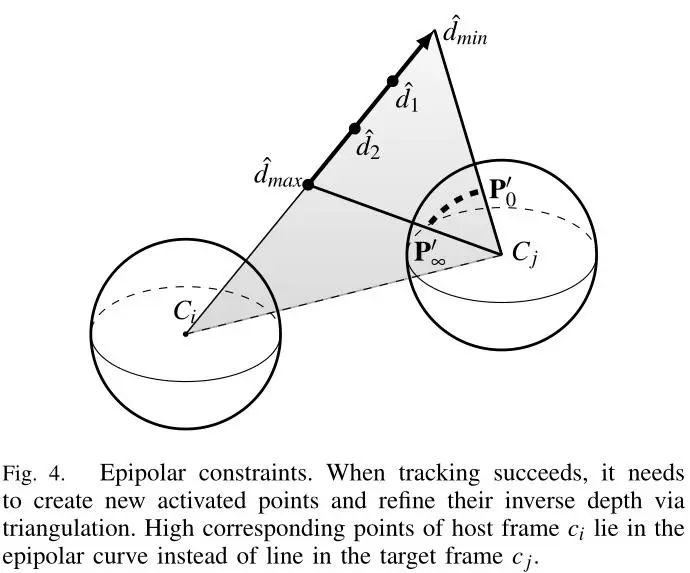

图4 极线约束。当成功追踪时需要创建新的激活点,并通过三角化来细化它们的逆深度。主帧Ci的高对应点位于极线曲线上,而非位于目标帧Cj中的直线上。

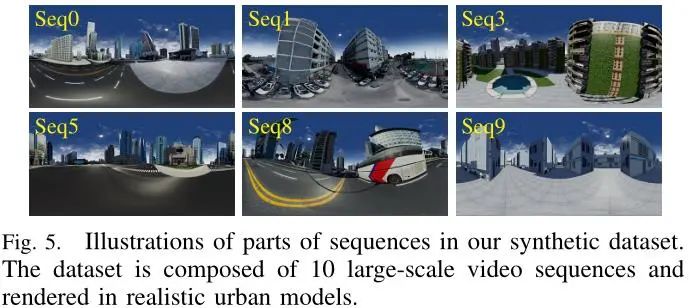

图5 合成数据集中部分序列的代表帧。该合成数据集是在真实的城市模型中渲染得到的,由10个大型视频序列组成。

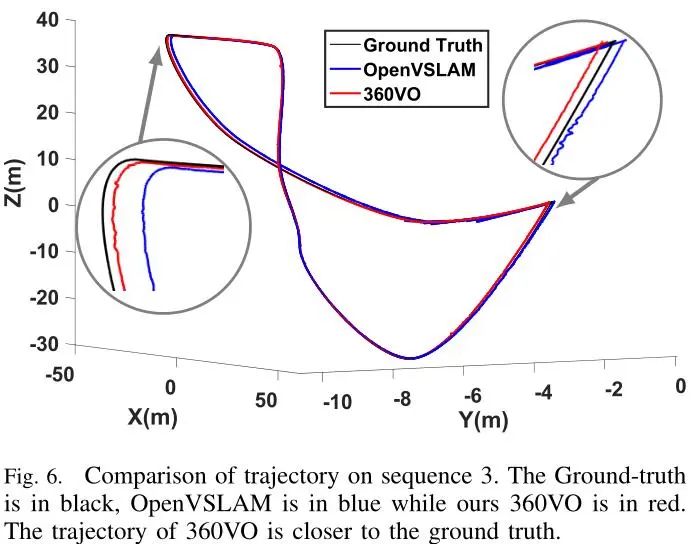

图6 基于序列3的轨迹比较。图中黑色曲线表示Ground-truth,蓝色曲线表示OpenVSLAM得到的轨迹,红色曲线表示本文提出的360VO得到的轨迹。结果显示360VO的轨迹更接近于真值。

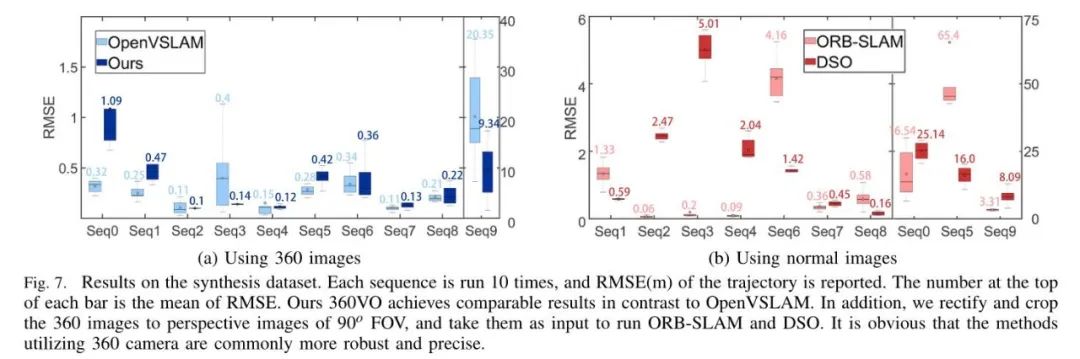

图7 上图是合成数据集得到的的结果。每个序列运行10次,得到轨迹的均方根误差(RMSE,Root Mean Square Error)。图中每个柱形顶部的数字是均方根误差的平均值。与OpenVSLAM相比,我们的360VO取得了可观的结果。此外,我们将360°的图像校正并裁剪为90°视场的透视图像,并将其作为运行ORB-SLAM和DSO的输入。显然,利用360相机的方法通常更鲁棒、精度更高。

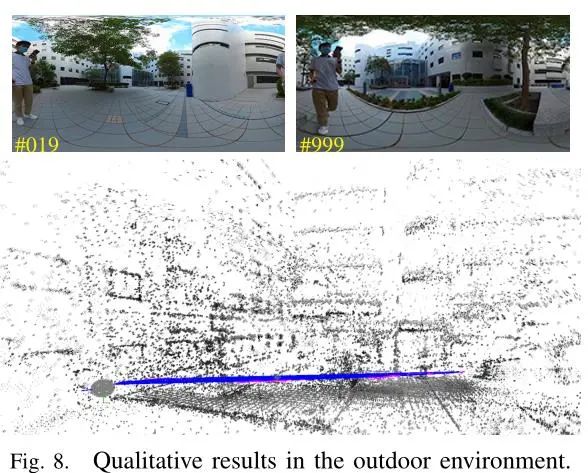

图8 360VO在室外环境中测试的定性结果

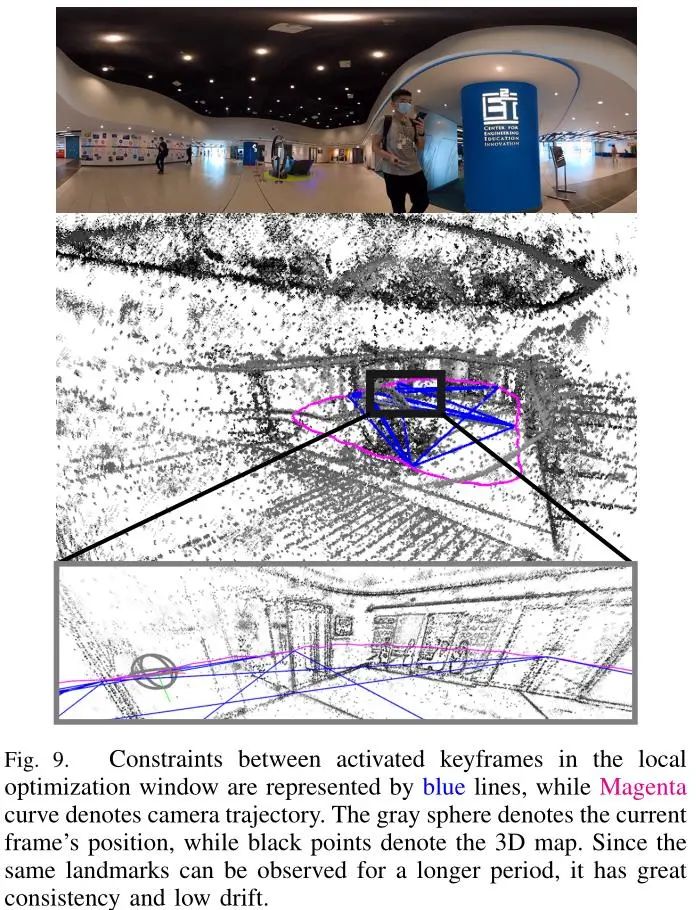

图9 图中蓝色线表示局部优化窗口中激活关键帧间的约束,品红色曲线表示相机轨迹。灰色的球体表示当前帧的位置,而黑色的点表示3D地图。由于同一个地标可以被长时间地观测到,本文中算法得到的结果具有较好的一致性和较低的漂移。

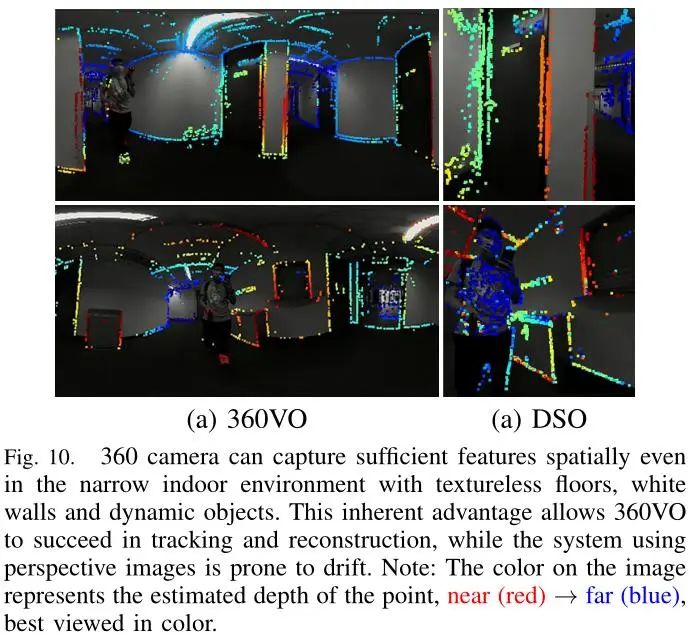

图10 即使在有着无纹理地板、白色墙壁和动态物体的狭窄的室内环境中,360相机也能在空间上捕捉到足够的特征。这种固有的优势使得360VO能够成功地跟踪和建图,而使用透视图像的系统则容易产生漂移。注:图像上的颜色表示点的估计深度,近(红色)→远(蓝色)

审核编辑 :李倩

-

如何去提高汽车里程计威廉希尔官方网站 的抗干扰能力?2021-05-19 0

-

如何理解SLAM用到的传感器轮式里程计IMU、雷达、相机的工作原理与使用场景?精选资料分享2021-07-27 0

-

请问如何理解SLAM用到的传感器轮式里程计IMU、雷达、相机的工作原理?2021-10-09 0

-

基于全景视觉与里程计的移动机器人自定位方法2011-06-28 801

-

基于视觉信标的仓储物流机器人定位方法2017-11-28 867

-

视觉里程计的研究和论文资料说明免费下载2018-12-03 579

-

视觉里程计的详细介绍和算法过程2019-08-08 26775

-

视觉语义里程计的详细资料说明2020-10-28 815

-

计算机视觉方向简介之视觉惯性里程计2021-04-07 2599

-

轮式移动机器人里程计分析2023-04-19 1929

-

介绍一种基于编码器合成里程计的方案2023-04-19 2243

-

介绍一种新的全景视觉里程计框架PVO2023-05-09 1853

-

基于相机和激光雷达的视觉里程计和建图系统2023-05-15 759

-

在城市地区使用低等级IMU的单目视觉惯性车轮里程计2023-06-06 1629

-

用于任意排列多相机的通用视觉里程计系统2024-12-13 215

全部0条评论

快来发表一下你的评论吧 !