使用深度学习技术的三大主要步骤(下)

人工智能

描述

深度神经需要特殊的训练技巧

随着层数变多,网络参数增多,随之运算量增大,通常都是超过亿万级的计算。对于这样复杂的结构,我们一定不会一个一个的计算,对于亿万级的计算,使用loop循环效率很低。

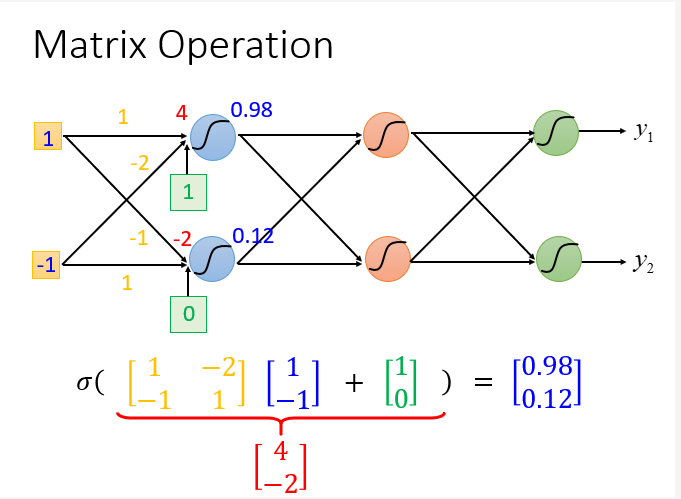

网络的运算过程如图所示:

上图中,网络的运算过程可看作是矩阵的运算。

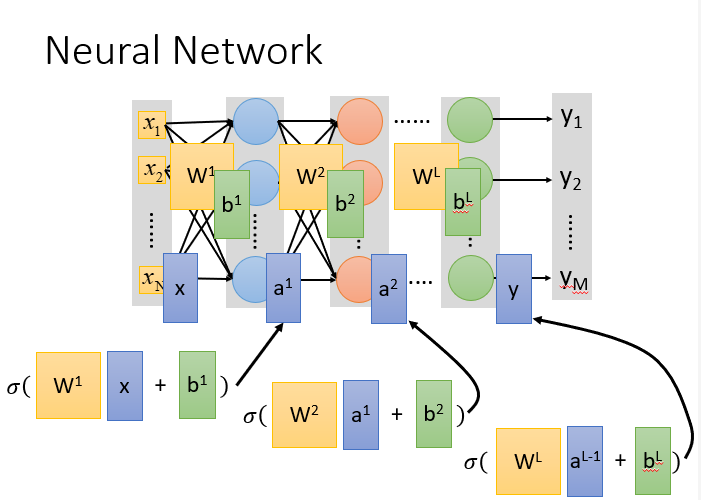

网络的计算方法就像是嵌套,所以整个神经网络运算就相当于一连串的矩阵运算。

从结构上看每一层的计算都是一样的,也就是用计算机进行并行矩阵运算。这样写成矩阵运算的好处是,你可以使用GPU加速,GPU核心多,可以并行做大量的矩阵运算。

神经网络的本质:通过隐藏层进行特征转换

隐藏层可以看作是对网络输入层输入特征进行特征处理,在最后一层隐藏层进行输出,这时的输出可以看作一组全新的特征,将其输出给输出层,输出层对这组全新的特征进行分类。

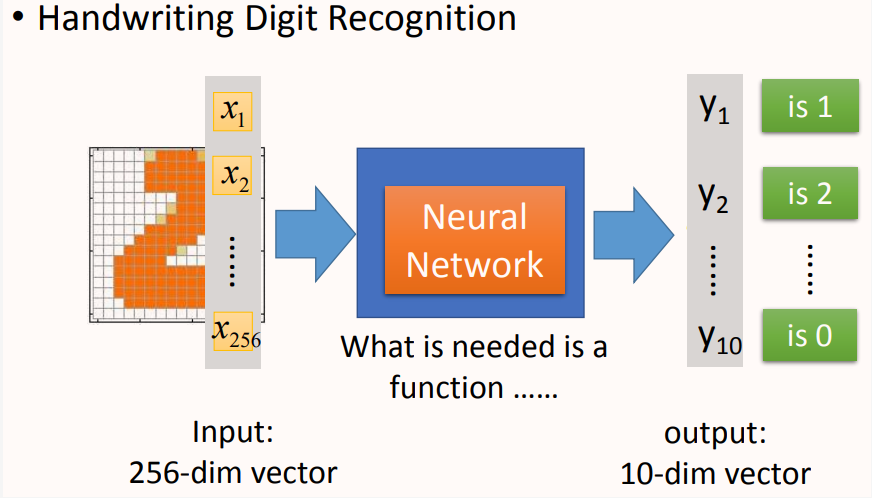

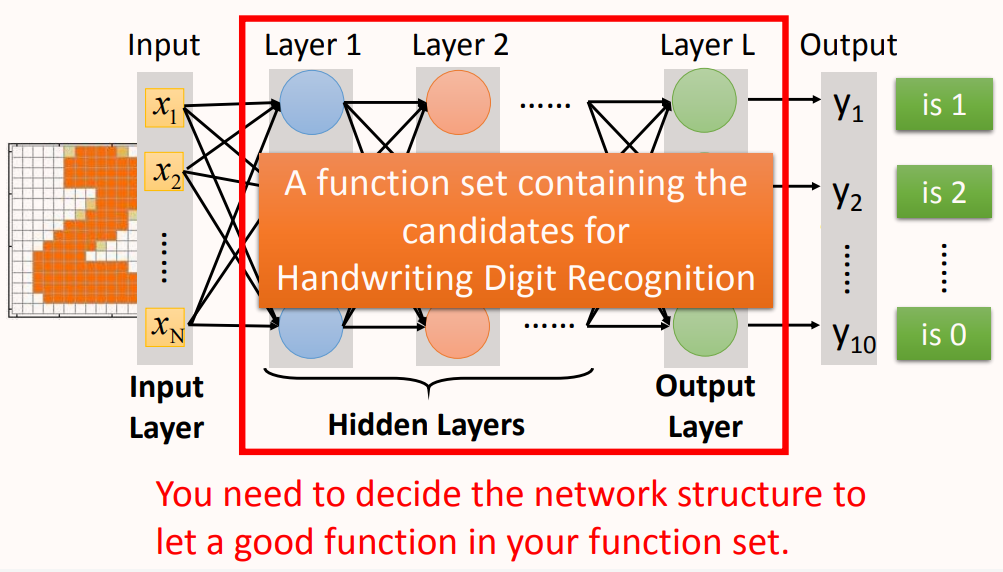

举例:手写数字识别

举一个手写数字体识别的例子:

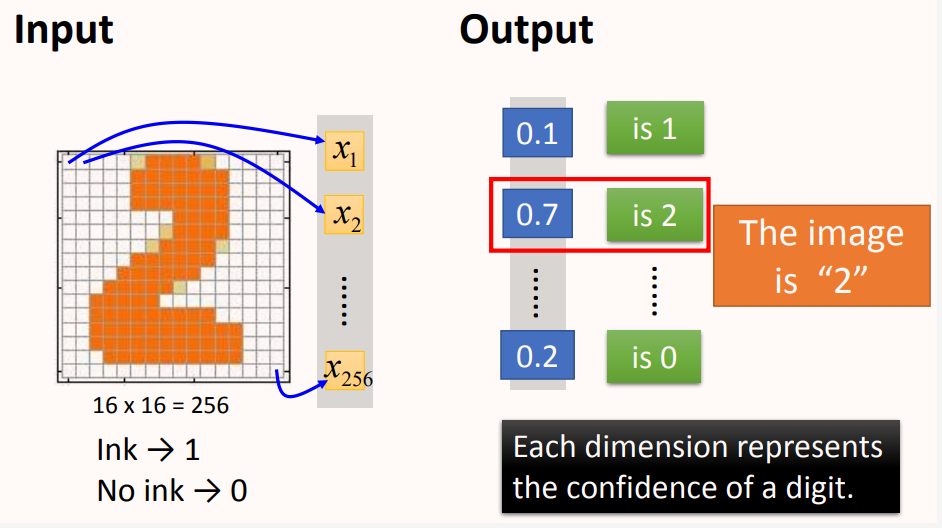

输入:一个16*16=256维的向量,每个pixel对应一个dimension,有颜色用(ink)用1表示,没有颜色(no ink)用0表示,将图片展平为一个256维的向量作为网络输入。

输出:10个维度,每个维度代表一个数字的置信度(可理解为是该数字的概率有多大)

从输出结果来看,每一个维度对应输出一个数字,代表模型输出为当前分类数字的概率。说明这张图片是2的可能性就是最大的。

在这个问题中,唯一确定的就是,输入是256维的向量,输出是10维的向量,我们所需要找的函数就是输入和输出之间的神经网络这个函数。

从上图看神经网络的结构决定了函数集(function set),通常来讲函数集中的函数越多越复杂,网络的表达空间就越大,越能handle复杂的模式,所以说网络结构(network structured)很关键。

接下来有几个问题:

- 多少层?每层有多少神经元?这个问我们需要用尝试加上直觉的方法来进行调试。对于有些机器学习相关的问题,我们一般用特征工程来提取特征,但是对于深度学习,我们只需要设计神经网络模型来进行就可以了。对于语音识别和影像识别,深度学习是个好的方法,因为特征工程提取特征并不容易。

- 结构可以自动确定吗?有很多设计方法可以让机器自动找到神经网络的结构的,比如进化人工神经网络(Evolutionary Artificial Neural Networks)但是这些方法并不是很普及 。

- 我们可以设计网络结构吗?可以的,比如 CNN卷积神经网络(Convolutional Neural Network )

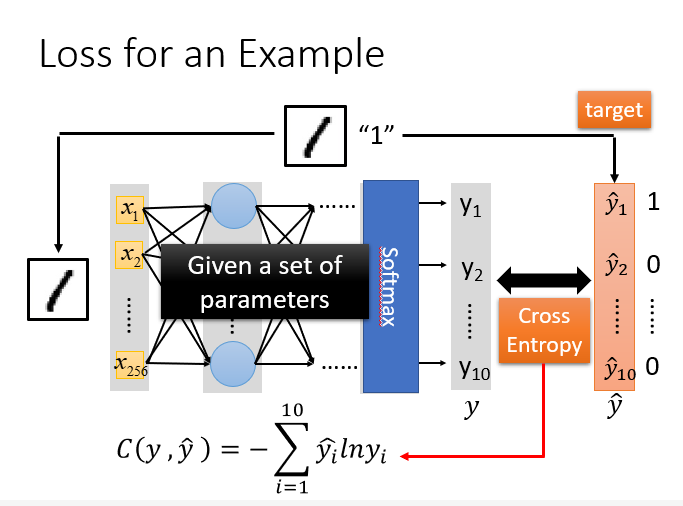

Step2:模型评估

损失示例

对于模型的评估,我们一般采用损失函数来反应模型的优劣,所以对于神经网络来说,我们可以采用交叉熵(cross entropy)函数来对

-

2017全国深度学习技术应用大会2017-03-22 0

-

基于深度学习技术的智能机器人2018-05-31 0

-

深度学习DeepLearning实战2021-01-09 0

-

深度强化学习实战2021-01-10 0

-

嵌入式学习步骤主要涉及的内容2021-01-13 0

-

嵌入式学习步骤的三个阶段2021-01-14 0

-

深度学习技术的开发与应用2022-04-21 0

-

什么是深度学习?使用FPGA进行深度学习的好处?2023-02-17 0

-

深度学习应用入门2017-09-30 699

-

深度学习的三种基本结构及原理详解2017-11-15 48477

-

深度学习助阵无人驾驶攻克三大识别技术2017-11-20 503

-

深度学习是什么?无人驾驶攻克三大识别技术不在话下2018-04-30 3021

-

深度学习框架连接技术2023-08-17 791

-

机器学习和深度学习的区别2023-08-28 1585

-

深度解析深度学习下的语义SLAM2024-04-23 1331

全部0条评论

快来发表一下你的评论吧 !