NVM对边缘AI有何优势?

电子说

描述

半导体技术、算法和数据科学的持续创新使得在越来越多的边缘设备中融入一定程度的人工智能推理功能成为可能。今天,我们在计算机视觉应用中看到了它,例如从手机和笔记本电脑到安全摄像头的产品上的物体识别、面部识别和图像分类。在工业系统中,推理可以实现预测性设备维护,并允许机器人独立执行任务。对于物联网和智能家居产品,人工智能推理可以实时监控和响应各种传感器输入。

目前支持AI推理的最低成本处理解决方案是用于物联网系统的现成单芯片微控制器。这种芯片将通用CPU、SRAM和IO功能与非易失性存储器(NVM)相结合。然而,这些芯片在CPU上运行的软件中实现了AI算法,这些算法只能提供适度的性能,并且仅适用于基本推理。扩展单芯片解决方案以提供更高性能的推理对设计人员来说是一个挑战。

如今,有望为要求苛刻的推理算法提供多个 Teraflops 性能的解决方案必须使用专用的 AI 加速硬件。为了在实现所需性能的同时将功耗降至最低,它们必须采用领先的工艺制造。事实上,如今市场上有许多片上系统 (SoC) 采用先进的工艺几何形状开发的专用 AI 加速硬件,效率相当高。

但是,这些通常是双芯片解决方案,其中AI计算引擎采用高级工艺(通常为22nm或更低)实现,NVM设备采用较旧的工艺技术。这是因为嵌入式闪存在 40nm 以下无法很好地扩展;在28nm时,成本对于大多数应用来说变得令人望而却步,因此在28nm时不存在嵌入式闪存。这意味着无法将闪存和高性能推理引擎集成到单个 SoC 中。

对于成本次于性能的应用,这种双芯片解决方案可能是可行的(想想像自动驾驶汽车这样的产品,它们需要存储在固态硬盘[SSD]中并通过DRAM运行的大型AI模型)。然而,对于低功耗边缘AI产品,双芯片解决方案的成本可能令人望而却步。在双芯片解决方案中,还需要连续从外部存储器获取权重,从而导致延迟和功耗增加。此外,双芯片解决方案存在潜在的安全风险,因为通过外部总线读取或修改NVM更有可能破解系统。

低成本、低功耗系统的“圣杯”是将加速器、NVM、SRAM 和 IO 组合在单个 SoC 上的单芯片(SoC 或 MCU)。从资源的角度来看,大多数小型低功耗物联网和其他AI边缘应用实际上并不需要双芯片解决方案。在这些应用中,AI 模型可以足够小,以适应 SoC 的内部 NVM。只有闪存有限的可扩展性才是挑战。

单芯片解决方案不仅可以节省成本;这将有可能实现更高的性能和更低的功耗,这既是因为存储器和执行单元之间的带宽更高,也是因为不需要跨芯片边界获取权重。而且,由于这些应用程序中的AI模型相对较小并且更新频率不高,因此片上NVM不仅可以用于代码存储的传统NVM任务;它还可用于保存AI权重和CPU固件。

如今,AI权重和CPU固件是从片上SRAM读取的。这种方法有几个缺点。首先,将权重存储在SRAM中意味着需要比其他方式更大的SRAM阵列。这增加了成本,因为SRAM本身就很昂贵,而且还增加了整体芯片尺寸,导致进一步的成本。此外,由于SRAM是一种易失性存储器技术,因此在启动时仍需要从外部闪存加载代码。没有即时启动。

利用 ReRAM 实现单芯片解决方案

电阻式 RAM(ReRAM 或 RRAM)是一种创新的 NVM 技术,可实现用于边缘 AI 推理的低成本、低功耗单芯片解决方案的愿景。ReRAM可以与芯片的其余部分一起扩展到高级工艺节点,因此它可以在与AI引擎相同的高级工艺上实现。

ReRAM可用于取代大型片上SRAM,以存储AI权重和CPU固件。由于该技术是非易失性的,因此无需在启动时等待从外部 NVM 加载 AI 模型。它比SRAM密度大得多,这使得它的每比特成本低于SRAM,因此可以在片上集成更多的存储器,以支持更大的神经网络,而芯片尺寸和成本相同。虽然数据存储仍然需要片上SRAM,但阵列将更小,整体解决方案更具成本效益。

虽然数据存储仍然需要片上SRAM,但用ReRAM取代大型片上SRAM来存储AI权重和CPU固件,可以减小芯片尺寸,提供更具成本效益的整体解决方案。(图片:Weebit Nano)

借助 ReRAM,设计人员可以在单个 IC 中实现高级 AI 的单芯片实现,同时节省芯片尺寸和成本。

展望未来:未来的 AI 架构

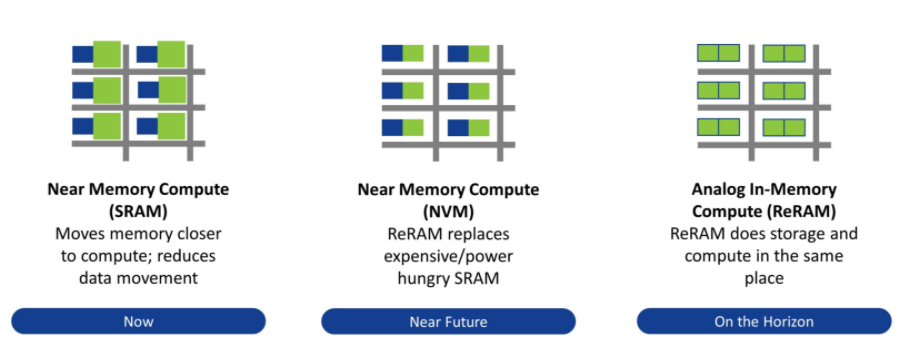

展望未来,ReRAM也将成为边缘AI未来的构建模块:神经形态计算(也称为内存模拟处理)。在此范例中,计算资源和内存驻留在同一位置,因此无需移动权重。神经网络矩阵成为ReRAM单元的数组,突触权重成为驱动乘法运算的NVM单元的电导。

未来的系统将模仿人脑的行为,对大量数据进行快速实时处理。(图片:Weebit Nano)

由于ReRAM细胞与人脑中的突触具有物理和功能相似性,因此可以使用ReRAM模拟人脑的行为,以便对大量数据进行快速实时处理。这样的解决方案将比当今传统处理器上的神经网络模拟能效高出几个数量级。Weebit正在与众多学术和商业合作伙伴合作,以在这一领域取得进展。

编辑:黄飞

-

AI边缘计算盒子优势有哪些?如何实现低延迟处理?2024-05-09 639

-

NanoEdge AI的技术原理、应用场景及优势2024-03-12 0

-

EdgeBoard FZ5 边缘AI计算盒及计算卡2020-08-31 0

-

【HarmonyOS HiSpark AI Camera】边缘计算安全监控系统2020-09-25 0

-

边缘计算对服务器系统SoC有何影响?2021-02-22 0

-

网络边缘实施AI的原因2021-02-23 0

-

一文了解边缘计算和边缘AI 精选资料分享2021-07-23 0

-

对边缘计算的炒作 我实在看不下去了2019-03-10 1614

-

IT部门应该怎样面对边缘计算2020-02-27 274

-

IT部门怎样应对边缘计算2020-03-17 357

-

AI技术对边缘计算有何影响?2020-08-10 2323

-

边缘计算带来的最大优势是什么?2020-09-23 10375

-

物联网设备需要怎样的边缘AI?2022-07-14 1409

-

锁定边缘运算领域,边缘AI的优势介绍2023-02-15 552

-

什么是AI边缘计算,AI边缘计算的特点和优势介绍2024-02-01 887

全部0条评论

快来发表一下你的评论吧 !