前言

我们日常做分页需求时,一般会用limit实现,但是当偏移量特别大的时候,查询效率就变得低下。本文将分四个方案,讨论如何优化MySQL百万数据的深分页问题,并附上最近优化生产慢SQL的实战案例。

limit深分页为什么会变慢?

先看下表结构哈:

CREATETABLEaccount(

idint(11)NOTNULLAUTO_INCREMENTCOMMENT'主键Id',

namevarchar(255)DEFAULTNULLCOMMENT'账户名',

balanceint(11)DEFAULTNULLCOMMENT'余额',

create_timedatetimeNOTNULLCOMMENT'创建时间',

update_timedatetimeNOTNULLONUPDATECURRENT_TIMESTAMPCOMMENT'更新时间',

PRIMARYKEY(id),

KEYidx_name(name),

KEYidx_update_time(update_time)//索引

)ENGINE=InnoDBAUTO_INCREMENT=1570068DEFAULTCHARSET=utf8ROW_FORMAT=REDUNDANTCOMMENT='账户表';

假设深分页的执行SQL如下:

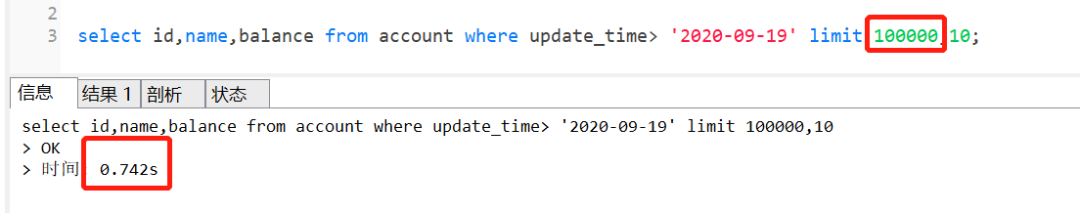

selectid,name,balancefromaccountwhereupdate_time>'2020-09-19'limit100000,10;

这个SQL的执行时间如下:

执行完需要0.742秒,深分页为什么会变慢呢?如果换成 limit 0,10,只需要0.006秒哦

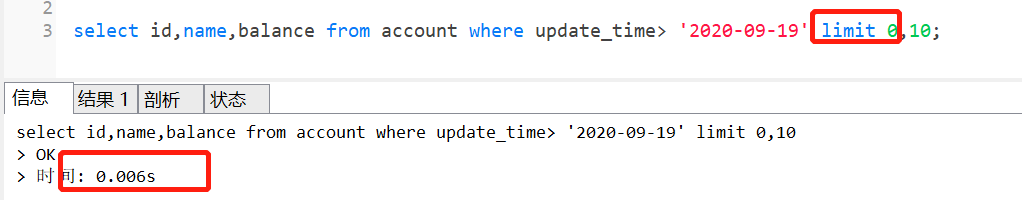

我们先来看下这个SQL的执行流程:

- 通过普通二级索引树idx_update_time,过滤update_time条件,找到满足条件的记录ID。

- 通过ID,回到主键索引树,找到满足记录的行,然后取出展示的列(回表)

- 扫描满足条件的100010行,然后扔掉前100000行,返回。

SQL的执行流程

SQL的执行流程

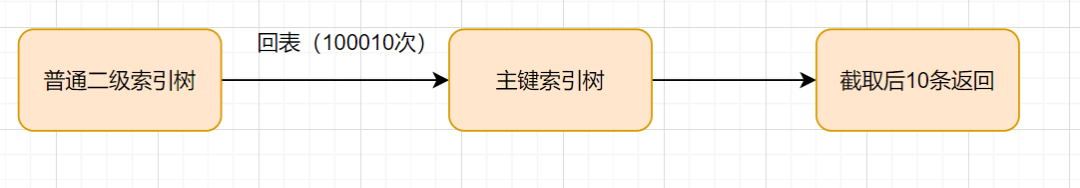

执行计划如下:

SQL变慢原因有两个:

-

limit语句会先扫描offset+n行,然后再丢弃掉前offset行,返回后n行数据。也就是说

limit 100000,10,就会扫描100010行,而limit 0,10,只扫描10行。 -

limit 100000,10扫描更多的行数,也意味着回表更多的次数。

通过子查询优化

因为以上的SQL,回表了100010次,实际上,我们只需要10条数据,也就是我们只需要10次回表其实就够了。因此,我们可以通过减少回表次数来优化。

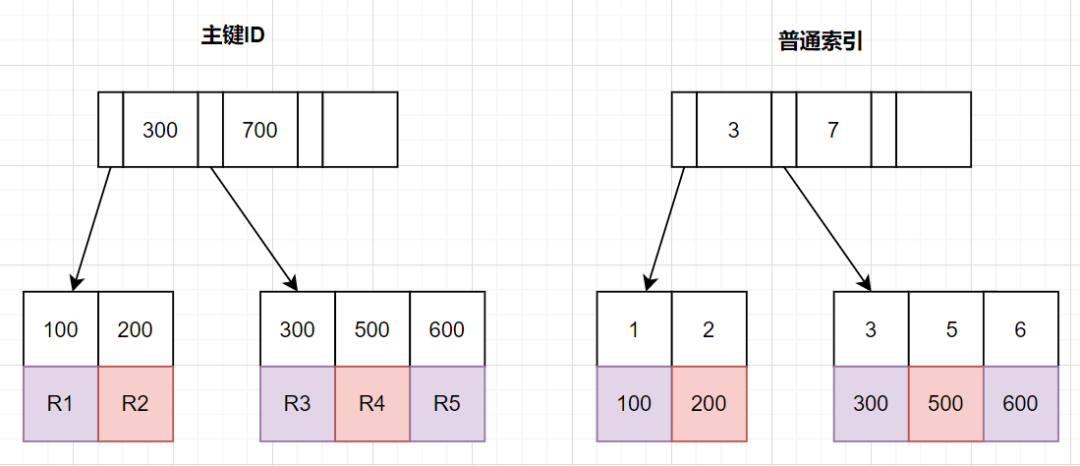

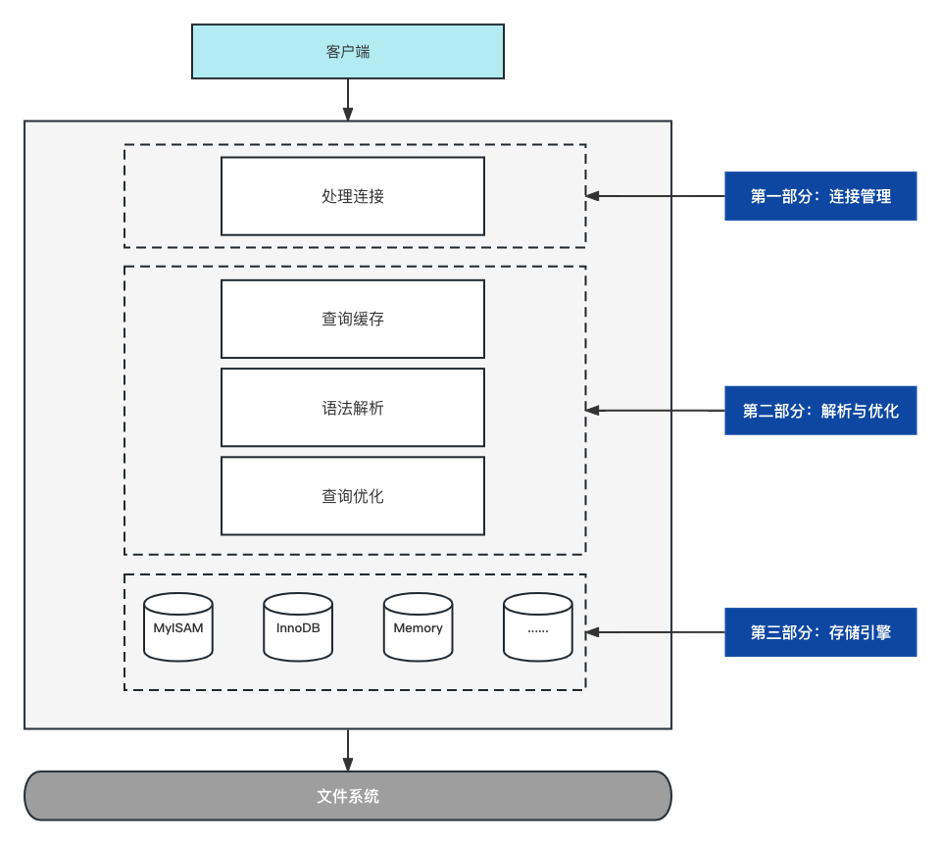

回顾B+ 树结构

那么,如何减少回表次数呢?我们先来复习下B+树索引结构哈~

InnoDB中,索引分主键索引(聚簇索引)和二级索引

- 主键索引,叶子节点存放的是整行数据

- 二级索引,叶子节点存放的是主键的值。

把条件转移到主键索引树

如果我们把查询条件,转移回到主键索引树,那就可以减少回表次数啦。转移到主键索引树查询的话,查询条件得改为主键id了,之前SQL的update_time这些条件咋办呢?抽到子查询那里嘛~

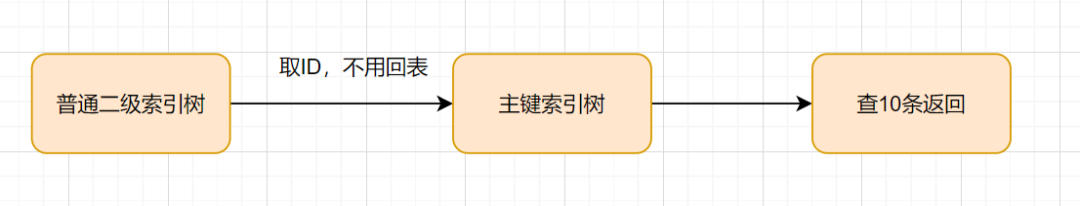

子查询那里怎么抽的呢?因为二级索引叶子节点是有主键ID的,所以我们直接根据update_time来查主键ID即可,同时我们把 limit 100000的条件,也转移到子查询,完整SQL如下:

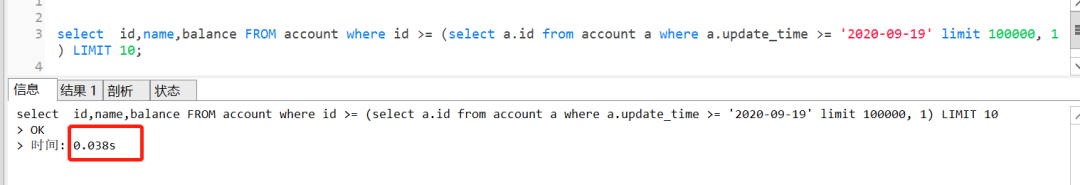

selectid,name,balanceFROMaccountwhereid>=(selecta.idfromaccountawherea.update_time>='2020-09-19'limit100000,1)LIMIT10;写漏了,可以补下时间条件在外面

查询效果一样的,执行时间只需要0.038秒!

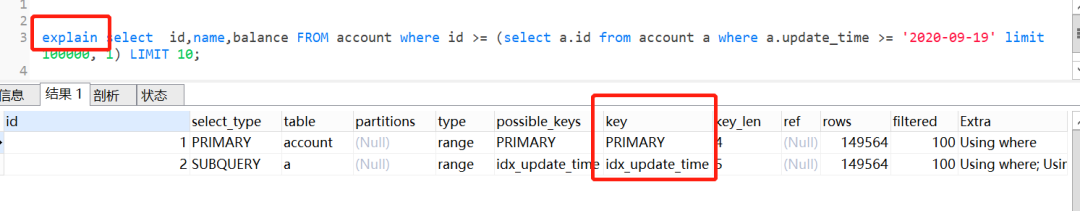

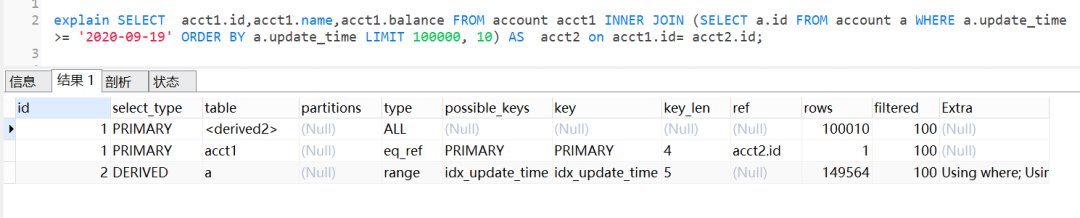

我们来看下执行计划

由执行计划得知,子查询 table a查询是用到了idx_update_time索引。首先在索引上拿到了聚集索引的主键ID,省去了回表操作,然后第二查询直接根据第一个查询的 ID往后再去查10个就可以了!

因此,这个方案是可以的~

INNER JOIN 延迟关联

延迟关联的优化思路,跟子查询的优化思路其实是一样的:都是把条件转移到主键索引树,然后减少回表。不同点是,延迟关联使用了inner join代替子查询。

优化后的SQL如下:

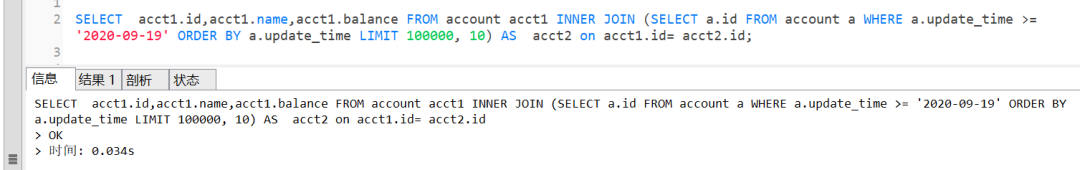

SELECTacct1.id,acct1.name,acct1.balanceFROMaccountacct1INNERJOIN(SELECTa.idFROMaccountaWHEREa.update_time>='2020-09-19'ORDERBYa.update_timeLIMIT100000,10)ASacct2onacct1.id=acct2.id;

查询效果也是杠杆的,只需要0.034秒

执行计划如下:

查询思路就是,先通过idx_update_time二级索引树查询到满足条件的主键ID,再与原表通过主键ID内连接,这样后面直接走了主键索引了,同时也减少了回表。

标签记录法

limit 深分页问题的本质原因就是:偏移量(offset)越大,mysql就会扫描越多的行,然后再抛弃掉。这样就导致查询性能的下降。

其实我们可以采用标签记录法,就是标记一下上次查询到哪一条了,下次再来查的时候,从该条开始往下扫描。就好像看书一样,上次看到哪里了,你就折叠一下或者夹个书签,下次来看的时候,直接就翻到啦。

假设上一次记录到100000,则SQL可以修改为:

selectid,name,balanceFROMaccountwhereid>100000orderbyidlimit10;

这样的话,后面无论翻多少页,性能都会不错的,因为命中了id索引。但是这种方式有局限性:需要一种类似连续自增的字段。

使用between...and...

很多时候,可以将limit查询转换为已知位置的查询,这样MySQL通过范围扫描between...and,就能获得到对应的结果。

如果知道边界值为100000,100010后,就可以这样优化:

selectid,name,balanceFROMaccountwhereidbetween100000and100010orderbyid;

手把手实战案例

我们一起来看一个实战案例哈。假设现在有表结构如下,并且有200万数据.

CREATETABLEaccount(

idvarchar(32)COLLATEutf8_binNOTNULLCOMMENT'主键',

account_novarchar(64)COLLATEutf8_binNOTNULLDEFAULT''COMMENT'账号'

amountdecimal(20,2)DEFAULTNULLCOMMENT'金额'

typevarchar(10)COLLATEutf8_binDEFAULTNULLCOMMENT'类型A,B'

create_timedatetimeDEFAULTNULLCOMMENT'创建时间',

update_timedatetimeDEFAULTNULLCOMMENT'更新时间',

PRIMARYKEY(id),

KEY`idx_account_no`(account_no),

KEY`idx_create_time`(create_time)

)ENGINE=InnoDBDEFAULTCHARSET=utf8COLLATE=utf8_binCOMMENT='账户表'

业务需求是这样:获取最2021年的A类型账户数据,上报到大数据平台。

一般思路的实现方式

很多伙伴接到这么一个需求,会直接这么实现了:

//查询上报总数量

Integertotal=accountDAO.countAccount();

//查询上报总数量对应的SQL

'countAccount'resultType="java.lang.Integer">

seelctcount(1)

fromaccount

wherecreate_time>='2021-01-010000'

andtype='A'

//计算页数

intpageNo=total%pageSize==0?total/pageSize:(total/pageSize+1);

//分页查询,上报

for(inti=0;i< pageNo; i++){

Listlist=accountDAO.listAccountByPage(startRow,pageSize);

startRow=(pageNo-1)*pageSize;

//上报大数据

postBigData(list);

}

//分页查询SQL(可能存在limit深分页问题,因为account表数据量几百万)

'listAccountByPage'>

seelct*

fromaccount

wherecreate_time>='2021-01-010000'

andtype='A'

limit#{startRow},#{pageSize}

实战优化方案

以上的实现方案,会存在limit深分页问题,因为account表数据量几百万。那怎么优化呢?

其实可以使用标签记录法,有些伙伴可能会有疑惑,id主键不是连续的呀,真的可以使用标签记录?

当然可以,id不是连续,我们可以通过order by让它连续嘛。优化方案如下:

//查询最小ID

StringlastId=accountDAO.queryMinId();

//查询最小ID对应的SQL

"queryMinId"returnType=“java.lang.String”>

selectMIN(id)

fromaccount

wherecreate_time>='2021-01-010000'

andtype='A'

//一页的条数

IntegerpageSize=100;

Listlist;

do{

list=listAccountByPage(lastId,pageSize);

//标签记录法,记录上次查询过的Id

lastId=list.get(list,size()-1).getId();

//上报大数据

postBigData(list);

}while(CollectionUtils.isNotEmpty(list));

"listAccountByPage">

select*

fromaccount

wherecreate_time>='2021-01-010000'

andid>#{lastId}

andtype='A'

orderbyidasc

limit#{pageSize}

-

SQL

+关注

关注

1文章

766浏览量

44169 -

MySQL

+关注

关注

1文章

816浏览量

26614

原文标题:聊聊如何解决 MySQL 深分页问题

文章出处:【微信号:DBDevs,微信公众号:数据分析与开发】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

数据库数据恢复—MYSQL数据库ibdata1文件损坏的数据恢复案例

什么是虚拟内存分页 Windows系统虚拟内存优化方法

MySQL还能跟上PostgreSQL的步伐吗

香港云服务器怎么部署MySQL数据库?

MySQL编码机制原理

适用于MySQL的dbForge架构比较

MySQL性能优化浅析及线上案例

华纳云:如何修改MySQL的默认端口

MySQL的整体逻辑架构

MySQL忘记root密码解决方案

Redis与MySQL协同升级企业缓存

如何将MS访问数据转换为MySQL

如何优化MySQL百万数据的深分页问题

如何优化MySQL百万数据的深分页问题

评论