资料下载

使用Edge Impulse在pico上进行手势识别

描述

在 Edge Impulse 等在线平台的帮助下,嵌入式机器学习现在变得很容易,并且允许创作者设计自己的应用程序,而只需要一点机器学习知识或根本不了解机器学习。

在这个项目中,我使用 MPU6050 加速计传感器和 pi pico 创建了一个基本的手势识别设备。该模型经过训练可以识别左右、上下和空闲运动,并且可以通过向其添加更多手势来进一步增强。识别的手势显示在 128*64 SSD1306 OLED 显示屏上,甚至来自串行监视器(可选)。

整个应用是在VScode上pico的C/C++ sdk和训练模型的edge impulse平台上开发的。

我制作这个项目只是为了学习目的,以便在不久的将来实施更多与嵌入式 ML 相关的项目。

单击此处查看公共边缘脉冲项目。

Edge Impulse 平台

Edge Impulse 是一个用于训练 ML 模型的 ML 开发平台,还允许您将这些模型部署到几乎所有嵌入式开发板上,例如本项目中使用的 Raspberry pi pico。

凭借对 ML 的最少了解,我能够按照平台中提到的步骤创建一个基本的手势识别模型。

单击此处了解有关边缘脉冲的更多信息。

训练模型

1:配置Pi-co

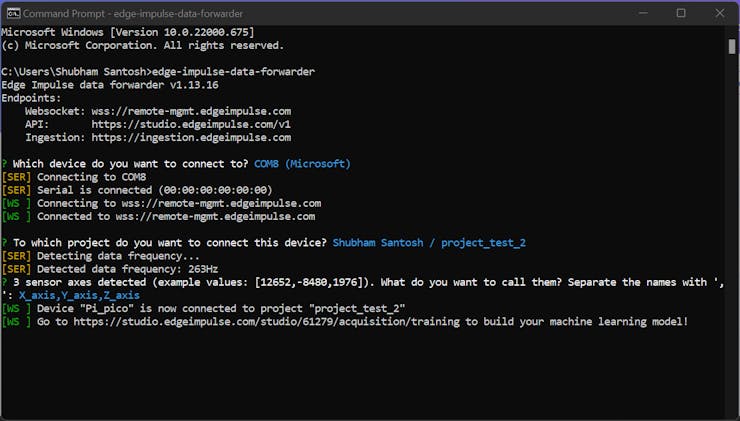

使用数据转发器,您只需使用几个命令即可从 CMD 连接您的 pico,数据转发器会自动计算设备的波特率和传感器频率,并将数据自动发送到服务。

按照此处的步骤了解数据转发器。

在将设备连接到 Edge Impulse 服务器之前,请确保在 pico 上上传数据转发器代码。

使用数据转发器配置

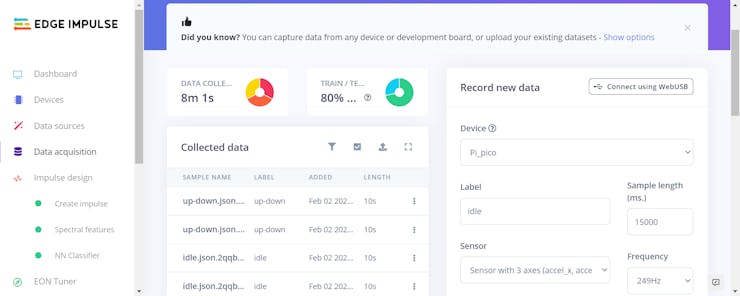

2:数据采集

根据文件类型,有多种方法可以将数据发送到 Edge Impulse Service。对于此应用程序,数据转发器还会在 pico 连接后处理数据采集。

这是来自加速度计的原始样本数据。

12628,-6600,1376 12624,-6584,1268 12684,-6620,1284 12532,-6648,1100 12636,-6752,1296 12644,-6672,1404

数据x-axis,y-axis,z-axis 以当时捕获的在线方式发送。

获取3个标签的数据,即up-down,left-right和idle。为每个标签收集 20 个样本进行训练。

每个样本收集 10 秒。例如,加速度计左右移动 10 秒以生成一个左右样本。

1 / 2 •捕捉左右运动

总共收集了 11 分钟的数据,分为训练集 8 分钟和测试集 3 分钟。

80% 留给训练集,20% 留给测试集

3:模型训练

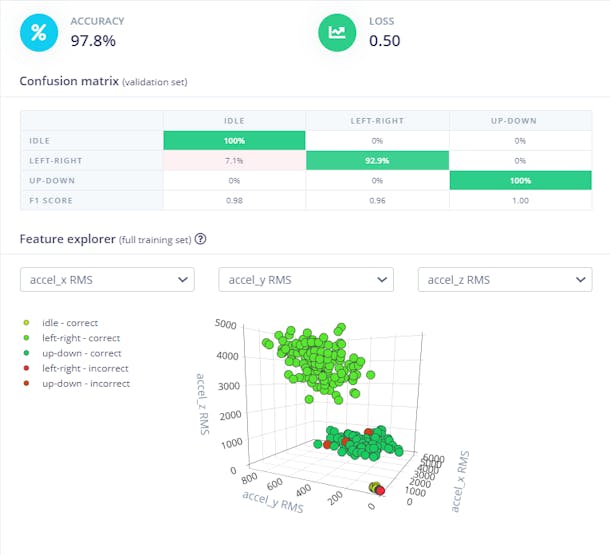

我使用了默认选项来训练模型。训练后的模型准确率为 97.8%。但是,这仅使用验证集进行评估,因此我们不能太依赖这种准确性。

培训成果

为了确定准确性,我使用实时推理来确定模型在那一刻的预测,这似乎很有希望。

4.部署

一旦经过训练的模型通过实时推理提供了良好的准确性,就可以在 pico 上部署它了。我已经从部署选项卡下载了 C/C++ 库(未优化的 float32),并使用 Arduino 脚本作为参考来开发用于 pico 的 C++ 脚本。当我使用量化的 int8 库时,我发现预测很差,这就是我选择未优化的 float32 库的原因。

添加 OLED 显示屏

在 pico 上测试模型后,我使用了 SSD1306 OLED 显示器来显示识别手势的图形图像。感谢Harbys git repo 提供 pico 的 OLED 驱动程序文件。

分别使用位图图像来显示左右和上下图像图标。这些图标取自谷歌图像并使用image2cpp工具转换为位图数组。

1 / 4 •上下图标

注意:当图像是从 Pico 的 USB 侧面面向面包板查看时,左右图像显示为上下,反之亦然。

利用多核

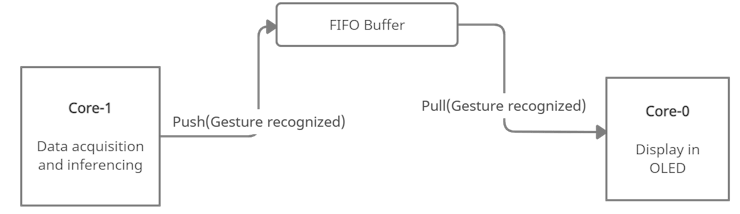

整个过程由 Pico 的两个内核处理,其中 core-1 处理执行数据采集和推理,core-0 负责 OLED 功能。我使用了两个内核,因为我想了解并行处理,这种方法将使我能够进一步向它添加更多功能(例如:在一个内核执行推理而另一个内核将数据发送到云服务器的应用程序中,或者到任何其他外围设备),我稍后可能会实施。

利用多核

最终输出

识别的手势显示在 OLED 显示屏上

参考

关于嵌入式机器学习和项目构想-点击此处查看coursera课程

MPU6050驱动开发-Vidura Embedded

SSD1306 OLED 驱动程序 - Harbys git repo

如何在 pico 上部署 Edge Impulse 模型 - Hardware.ai

声明:本文内容及配图由入驻作者撰写或者入驻合作网站授权转载。文章观点仅代表作者本人,不代表电子发烧友网立场。文章及其配图仅供工程师学习之用,如有内容侵权或者其他违规问题,请联系本站处理。 举报投诉

- 相关下载

- 相关文章